El objetivo de este trabajo es la investigación de algoritmos para la coordinación de módulos

de control que guíen visualmente el comportamiento de un robot humanoide, todo esto dentro

de un marco de toma de decisiones. Esto incluye la jerarquización y estructuración por niveles

del sistema motor ocular y de visión del robot, donde cada nivel representa un módulo de control

que sea capaz de tomar decisiones que ayuden a la reducción de la incertidumbre presente en

ese módulo, con el fin de aumentar la confiabilidad en su respuesta. Dichos módulos pueden

ser analizados y manejados de forma independiente, pero al final deberán ser coordinados para

la correcta realización de la tarea que esté siendo desempeñada por los sistemas motores del

robot. Los módulos de control que se manejarán son:

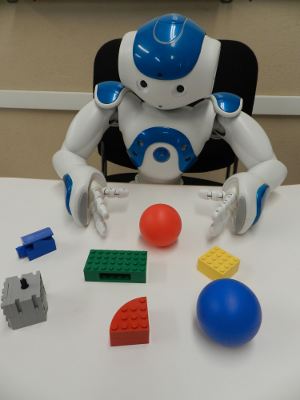

La asignación del sistema de visión a un sistema motor en particular (decidir hacia donde ver); la detección de objetos y generación de

regiones de interés; identificación y categorización de objetos; la reconstrucción 3D de objetos

para manipulación. Además de que estos módulos deben ser implementados teniendo en cuenta que el robot trabajará en

tiempo real.